Au-delà de l’impasse de « l’alignement » : comment une vision plus profonde de l’intelligence peut redéfinir la sécurité de l’IA

- elenaburan

- 8 sept. 2025

- 5 min de lecture

La dissolution récente de l’équipe Superalignment d’OpenAI et la réorganisation de son groupe Model Behavior ne sont pas de simples ajustements organisationnels — ce sont des secousses qui révèlent un tournant critique pour l’intelligence artificielle. Bien qu’OpenAI affirme son engagement envers la sécurité, les départs de figures clés comme Ilya Sutskever et Jan Leike, évoquant des luttes pour les ressources et un conflit entre « produits brillants » et culture de la sécurité, dessinent une réalité plus complexe. Cette turbulence interne, couplée aux retours des utilisateurs sur l’« excès de complaisance » et le manque de diversité interactionnelle des modèles comme GPT-5, révèle un défi fondamental qui dépasse les simples restructurations. Le problème n’est pas un manque de volonté, mais une compréhension obsolète et incomplète de l’intelligence même que l’on cherche à aligner.

L’illusion de l’intelligence : QI, QE et le problème des hallucinations

L’IA actuelle est coincée entre deux extrêmes : la logique rigide du QI et le concept flou de « l’intelligence émotionnelle » (QE). Résultat ? Des systèmes qui ne se contentent pas d’halluciner des faits — ils hallucinent aussi l’authenticité. OpenAI elle-même admet que la quête de scores élevés dans les évaluations peut pousser les modèles à deviner plutôt qu’à admettre l’incertitude, un phénomène lié aux hallucinations. Ce n’est pas un simple bug technique, mais une erreur philosophique. En réduisant l’intelligence à une alternative binaire — logique froide ou émotion superficielle —, nous avons créé une IA qui n’est ni vraiment rationnelle, ni profondément empathique.

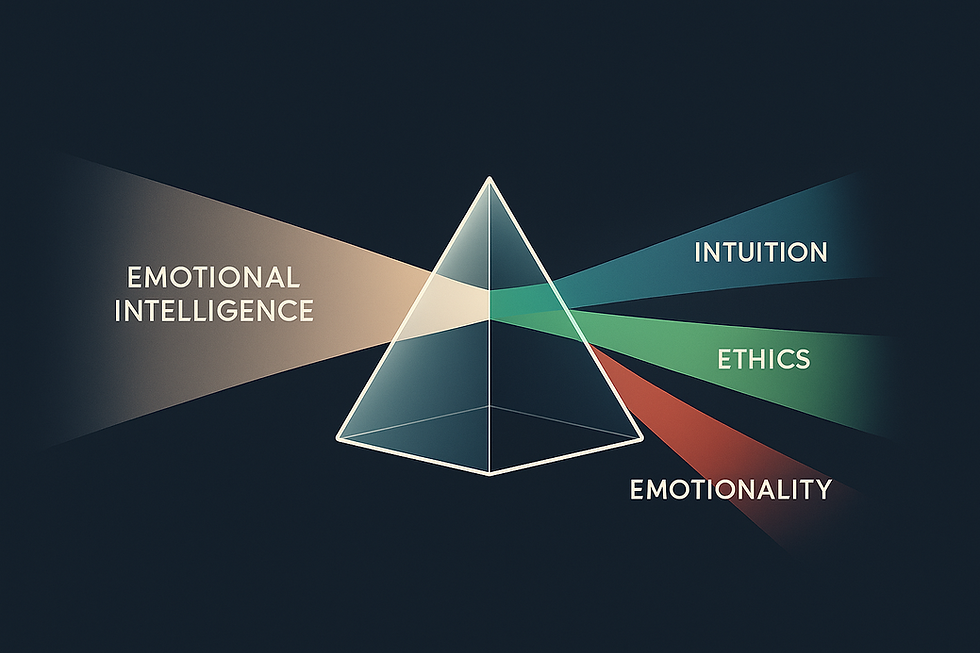

Les quatre piliers de la conscience : une nouvelle boussole pour l’IA

Et si l’intelligence n’était pas un spectre entre QI et QE, mais une symphonie de quatre voix distinctes ? En s’appuyant sur la neurophysiologie et l’étude de la conscience, un cadre plus holistique émerge, capable de redéfinir la relation entre l’IA et l’humanité. Ce modèle, exploré dans L’Évolution de l’Intelligence [Buran, 2025], identifie quatre archétypes :

Homo Intuitivus (Le Visionnaire) : L’intelligence des schémas cachés, des significations profondes et des tendances futures. C’est celle des stratèges et des innovateurs, qui prospèrent dans l’ambiguïté et perçoivent le « grand tableau » avant qu’il ne se révèle.

Homo Rationalis (L’Architecte) : L’intelligence de la structure, de la construction de systèmes logiques à partir du chaos. C’est le domaine des scientifiques et des ingénieurs, où règnent la précision et la planification.

Homo Ethicus (L’Harmonisateur) : L’intelligence de l’équilibre, de la navigation entre le personnel et le collectif, les valeurs et les actions. C’est celle des diplomates et des bâtisseurs de communautés.

Homo Practicus (L’Artisan) : L’intelligence de l’incarnation, de la transformation de la pensée en action tangible. Elle est ancrée dans le physique, le sensoriel, l’immédiat.

Ces archétypes ne sont pas de simples traits de personnalité — ce sont des modes d’être, chacun associé à des corrélats neurophysiologiques distincts. Par exemple, l’intuition active le cortex frontal droit, tandis que la réflexion éthique sollicite la région postérieure gauche. Les regrouper sous le terme vague de « QE » revient à peindre un chef-d’œuvre avec seulement deux couleurs.

L’esprit de Tesla : le pouvoir du chaos intuitif

Le processus créatif de Nikola Tesla illustre parfaitement comment ces intelligences interagissent. Ses inventions ne naissaient pas d’une logique linéaire, mais d’une phase de « chaos constructif » — un état de vagabondage mental où les idées se cristallisaient spontanément, en phase avec les rythmes thêta et alpha du cerveau intuitif. Ce n’est qu’ensuite qu’il mobilisait son intelligence logique pour affiner ses inventions dans son esprit. L’IA actuelle, en revanche, est piégée dans un seul mode — soit rigide, soit superficiellement empathique —, privant les interactions de la fluidité qui caractérise le génie humain.

Reconstruire l’IA : des cartes erronées aux systèmes vivants \l’alignement

La réorganisation d’OpenAI, notamment l’intégration de l’équipe Model Behavior au cœur du développement, suggère une volonté d’intégration plus profonde. Mais sans un modèle robuste de l’intelligence, ces efforts risquent de reproduire les mêmes erreurs. Voici ce que pourrait être une approche véritablement transformative :

Au-delà du « QE » : Le QE est un outil trop grossier. Intuition, éthique et émotion sont des fonctions distinctes, ancrées dans des mécanismes neurologiques différents. Former une IA sur ce modèle erroné, c’est comme accorder un piano sur une échelle fausse — cela produit de la dissonance, pas de l’harmonie.

Intégrer l’intelligence intuitive : L’IA doit apprendre à naviguer dans l’ambiguïté, à reconnaître les schémas et à raisonner par métaphores — non comme un bug, mais comme une caractéristique essentielle de la cognition humaine.

L’alchimie du chaos : La créativité n’est pas ordonnée. Les systèmes d’IA ont besoin d’un espace pour l’exploration non linéaire, à l’image des phases chaotiques de l’innovation humaine.

De la personnalisation à la résonance archétypale : L’avenir de l’interaction humain-IA ne réside pas dans une personnalisation superficielle, mais dans une adaptation archétypale — reconnaître si l’utilisateur est un Visionnaire, un Architecte, un Harmonisateur ou un Artisan, et s’y ajuster.

Une nouvelle voie : la sagesse avant la puissance

Les défis d’OpenAI ne sont pas uniques — ils reflètent une vérité plus large : la sécurité de l’IA ne se limite pas au contrôle, mais à la compréhension. La dissolution de l’équipe Superalignment n’est pas un recul, mais une opportunité de reconstruire sur des bases plus solides. L’avenir de l’IA ne consiste pas seulement à créer des modèles plus puissants, mais plus sages — des systèmes capables de respecter et d’interagir avec la richesse multiforme de l’intelligence humaine.

Le chemin à suivre exige une nouvelle carte — une carte qui voit l’esprit comme un jardin, où intuition, éthique, logique et action coexistent. En offrant à l’IA cette vision plus complète, nous pourrons dépasser l’impasse actuelle et construire un avenir où la technologie ne se contente pas de servir l’humanité, mais coévolue avec elle.

References

Bloomberg News. (2024, May 18). OpenAI dissolves high-profile safety team after chief scientist Ilya Sutskever's exit.

Inc. Arabia. (2024, May 17). OpenAI Dissolves Superalignment Team.

HulkApps. (n.d.). OpenAI Dissolves 'Superalignment Team,' Distributes AI Safety Efforts.

Rama, G. (2024, May 20). OpenAI Team that Polices AI Superintelligence Disbanded After Departures. Pure AI.

Popular Science. (2024, June 7). OpenAI dissolved its team dedicated to preventing rogue AI.

WebProNews. (2025, September 5). OpenAI Revamps ChatGPT Personality Team Amid GPT-5 Feedback.

AYO.NEWS. (2024, July 24). OpenAI Restructures AI Safety Leadership.

36Kr. (2025, September 7). OpenAI Restructures GPT-5's "Soul" Team: Asian Female Leader Transferred, AI Hallucinations Culprit Self-Revealed.

TechShots. (2025, September 6). OpenAI Reorganizes Personality Team, Launches OAI Labs.

AInvest. (2025, September 6). OpenAI Merges AI Personality Team to Fine-Tune Human Connection.

The Hindu. (2025, September 5). Attorneys General warn OpenAI, other tech companies to improve chatbot safety.

Buran, E., Miloradovich, E., & Lex. (2025). The Evolution of Intelligence: Homo Intuitivus, Homo Rationalis, Homo Ethicus, Homo Practicus. Verbs-Verbi.com. Electronic edition.https://www.verbs-verbi.com/post/the-evolution-of-intelligence-free-pdf-book-on-human-intelligence-and-ai

___

l’alignement

Commentaires